Ist der Einsatz von KI in der internen Kommunikation laut EU AI Act erlaubt?

Die kurze Antwort

Künstliche Intelligenz (KI) im Intranet ist unter dem EU AI Act in den meisten Fällen erlaubt. Der Grund: Typische Anwendungen wie KI-Assistenten, intelligente Suche oder automatische Zusammenfassungen fallen in die niedrigsten Risikokategorien der Verordnung und treffen keine Entscheidungen über Personen. Der EU AI Act folgt einem risikobasierten Ansatz: Je mehr ein KI-System über Menschen entscheidet oder sie beeinflusst, desto strenger die Regulierung. KI im Intranet soll Mitarbeitende unterstützen, nicht über sie entscheiden — so die klare Einschätzung von IT-Rechtsexpert*innen, die in einem Webinar zum EU AI Act über KI in der internen Kommunikation gesprochen haben.

Das eigentliche Compliance-Risiko kommt nicht vom EU AI Act, sondern von der DSGVO. Sie greift immer dann, wenn personenbezogene Daten verarbeitet werden. Das ist bei KI im Unternehmenskontext fast immer der Fall. Wer seinen KI-Einsatz nur am AI Act misst, hat die falsche Frage gestellt.

Wie funktioniert die Risikoklassifizierung des EU AI Acts?

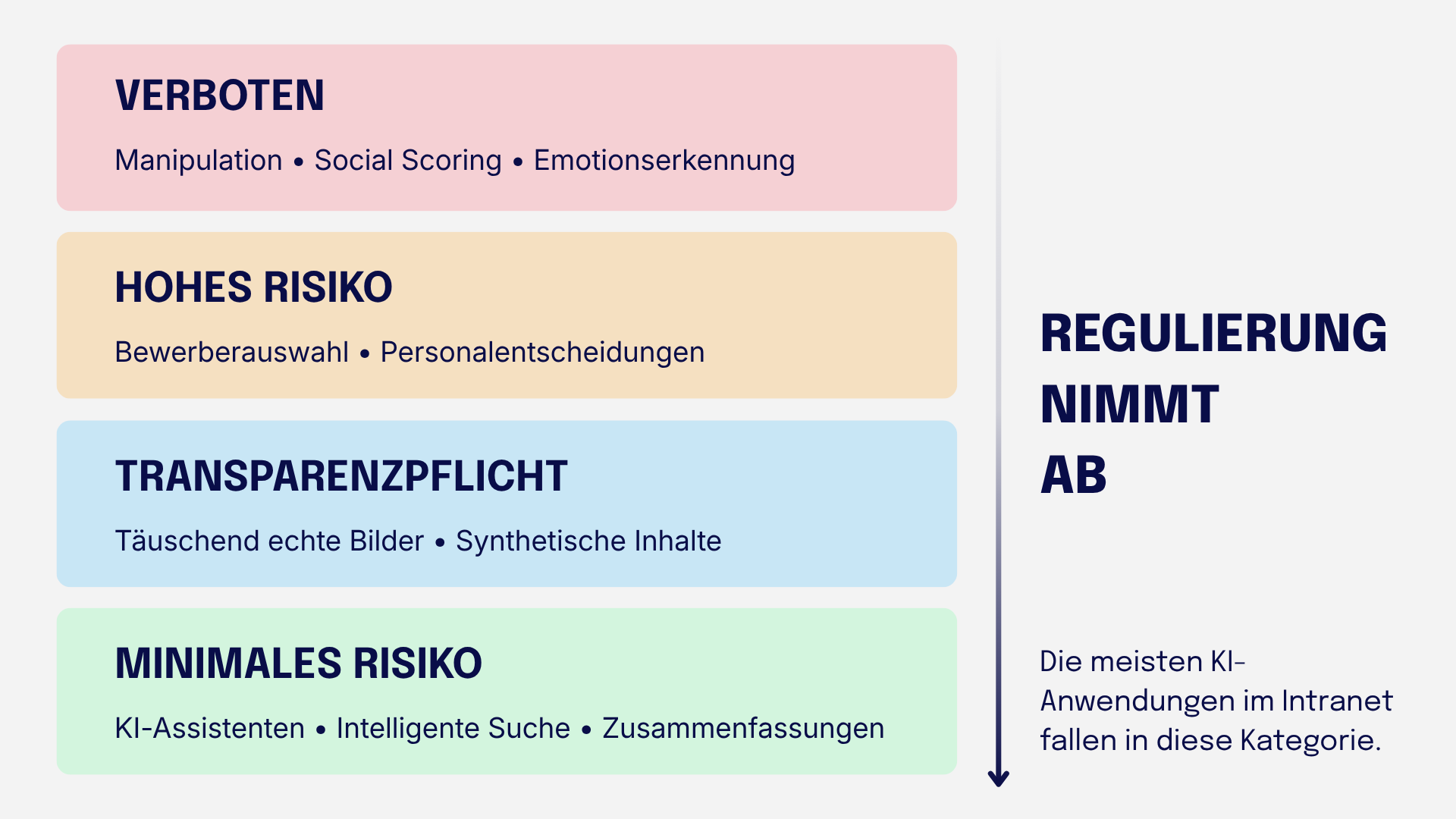

Die Verordnung unterscheidet vier Kategorien. Verbotene Systeme, darunter Manipulation, Emotionserkennung am Arbeitsplatz oder Social Scoring, dürfen nicht eingesetzt werden. Hochrisiko-Anwendungen wie automatisierte Bewerberauswahl oder Personalentscheidungen sind erlaubt, unterliegen aber strengen Auflagen. KI mit Transparenzpflichten, etwa täuschend echte Bilder oder Texte, muss als KI-generiert gekennzeichnet werden. Und KI mit minimalem Risiko, in die die meisten Intranet-Anwendungen fallen, ist weitgehend unreguliert.

Die Verordnung unterscheidet vier Kategorien. Verbotene Systeme, darunter Manipulation, Emotionserkennung am Arbeitsplatz oder Social Scoring, dürfen nicht eingesetzt werden. Hochrisiko-Anwendungen wie automatisierte Bewerberauswahl oder Personalentscheidungen sind erlaubt, unterliegen aber strengen Auflagen. KI mit Transparenzpflichten, etwa täuschend echte Bilder oder Texte, muss als KI-generiert gekennzeichnet werden. Und KI mit minimalem Risiko, in die die meisten Intranet-Anwendungen fallen, ist weitgehend unreguliert.

KI-Anwendung im Unternehmen | EU-AI-Act-Risiko | Beispiel im Intranet-Kontext | Was das praktisch bedeutet |

|---|---|---|---|

KI-Assistent für HR-Fragen | Minimal | Antworten zu Urlaub, Richtlinien | Kaum AI-Act-Auflagen – DSGVO beachten, sobald Profildaten genutzt werden |

Automatische Zusammenfassungen | Minimal | News, Updates, Artikel | Keine direkte Regulierung |

Personalisierte Inhalte (z. B. KI-Podcast) | Minimal / Begrenzt | Inhalte auf Basis von Mitarbeiterprofilen | Niedrige AI-Act-Stufe, aber Zweck der Datennutzung DSGVO-relevant |

KI-generierte Inhalte | Begrenzt | Texte, Bilder, synthetische Videos | Kennzeichnung erforderlich, wenn nicht als KI erkennbar |

Gespeicherte KI-Interaktionen zur Nutzungsanalyse | Begrenzt / Grauzone | Fragen an KI-Assistent werden ausgewertet | Zulässig für Systemoptimierung – nicht zur Bewertung einzelner Mitarbeitender |

Videokonferenz-Tool mit Verhaltensauswertung | Hochrisiko | Avatar bewertet Verkaufsgespräche | Erlaubt, aber strenge Auflagen – kein Social Scoring, aber nah dran |

Bewerber-Chatbot mit Einfluss auf Auswahl | Hochrisiko | Tipps oder Kriterien im Recruiting | Strenge Anforderungen, Menschenkontrolle zwingend |

Emotionserkennung am Arbeitsplatz | Verboten | Webcam-Analyse von Gesichtsausdrücken | Nicht erlaubt |

Das größte Missverständnis: „Wer den EU AI Act erfüllt, ist auf der sicheren Seite!“

Das ist eine Beobachtung, die IT-Rechtsexpert*innen aus ihrer Beratungspraxis immer wieder berichten, so auch im Webinar „Ask Me Anything: EU AI Act, DSGVO und KI im Intranet“.

Viele Unternehmen reagieren auf den EU AI Act wie auf die Einführung der DSGVO: erst mal abwarten, bis die Lage klarer ist. Das ist verständlich, führt aber zur falschen Schlussfolgerung.

Denn die strengsten Regeln der Verordnung zielen nicht auf Intranet-KI. Sie zielen auf etwas ganz Bestimmtes: Systeme, die Menschen verdeckt beeinflussen, über sie entscheiden oder sie bewerten. Verboten sind beispielsweise Manipulation, Social Scoring und Emotionserkennung am Arbeitsplatz. Hochrisiko sind unter anderem automatisierte Bewerberauswahlsysteme oder KI im Personalmanagement, weil dort Grundrechte und Chancengleichheit auf dem Spiel stehen.

Wer den EU AI Act prüft und dann denkt, die Compliance-Arbeit sei getan, hat die zweite Hürde noch nicht gesehen. Wie es die Rechtsexpert*innen im Webinar zum EU AI Act formulierten: Wer den AI Act umschifft hat, bei dem geht das Spiel erst richtig los. Dann kommen DSGVO und Arbeitsrecht.

Welche KI-Anwendungen im Unternehmenskontext können wirklich problematisch sein?

Die Grenze zwischen erlaubter und problematischer KI verläuft nicht dort, wo viele sie vermuten. Nicht das Tool ist entscheidend, sondern was es mit den Daten macht und welche Folgen das für Mitarbeitende hat.

Drei Szenarien aus der Praxis, die regulatorisch heikel sind:

Emotionserkennung am Arbeitsplatz

Eine Webcam-Software, die kontinuierlich analysiert, wie oft Mitarbeitende gestresst oder genervt wirken, und diese Auswertung dem Arbeitgeber zur Verfügung stellt. Das ist ein klassischer Verbotstatbestand. Das Gleiche kann auch ohne Kamera entstehen: Wird aus Intranet-Kommentaren oder Texten automatisiert auf die Stimmungslage einzelner Personen geschlossen, bewegt man sich laut Rechtsexpert*innen zumindest in einer rechtlichen Grauzone, die einer umfassenden Bewertung bedarf.

Automatisierte Bewerberauswahl

Ein Chatbot, der Bewerbenden Tipps gibt oder Auswahlkriterien nennt, ist kein neutrales Werkzeug mehr, sondern wird zu einer Hochrisiko-Anwendung, weil er in Entscheidungen über Karrieren eingreift, bei denen ein menschliches Urteil unerlässlich ist.

Social Scoring

Systeme, die Mitarbeitende auf Basis von Verhalten oder Aktivität bewerten und diese Scores mit anderen Bereichen verknüpfen, etwa Boni oder Beförderungsentscheidungen, sind verboten. Entscheidend ist dabei nicht nur die Erhebung von Scores, sondern deren willkürliche Weiterverwendung in anderen Kontexten.

Was diese Szenarien gemeinsam haben: Sie bewerten Menschen, beeinflussen ihre Chancen oder greifen in ihre Entscheidungsfreiheit ein. Genau das ist der Kern der schärfsten EU-AI-Act-Regelungen. Typische Intranet-KI tut nichts davon. Sie hilft Mitarbeitenden, Informationen zu finden, Inhalte zu verstehen und effizienter zu kommunizieren.

Szenario | Warum problematisch | Risiko-Level | Empfehlung |

|---|---|---|---|

Webcam-basierte Emotionserkennung | Analysiert kontinuierlich Gefühlszustände von Mitarbeitenden ohne deren Kontrolle | Verboten | Nicht einsetzen |

Stimmungsanalyse aus Intranet-Texten | Schließt automatisiert auf Stimmung einzelner Personen — rechtliche Grauzone | Verboten / Grauzone | Rechtliche Prüfung im Einzelfall erforderlich |

Bewerber-Chatbot mit Auswahleinfluss | Greift in karriererelevante Entscheidungen ein, bei denen menschliches Urteil nötig ist | Hohes Risiko | Menschliche Kontrolle sicherstellen, strenge Auflagen beachten |

Social Scoring mit Konsequenzen | Verknüpft Verhaltensbewertungen mit Boni oder Beförderungen — willkürliche Weiterverwendung | Verboten | Nicht einsetzen |

Welche KI-Anwendungen im Intranet gelten als geringes Risiko?

Der Gegenentwurf zu den problematischen Szenarien ist weniger komplex als viele vermuten. Das ist die eigentlich beruhigende Botschaft des EU AI Act für die interne Kommunikation.

Typische Intranet-KI-Anwendungen fallen in der Regel in die Kategorie mit minimalem oder begrenztem Risiko. Das gilt für:

KI-Assistenten, die Mitarbeitenden direkte Antworten auf Fragen zu HR-Richtlinien oder internen Prozessen geben

eine intelligente Suche, die Inhalte aus dem Intranet zusammenfasst und strukturiert aufbereitet

automatische Übersetzungen, Artikel-Zusammenfassungen oder KI-gestützte Unterstützung beim Schreiben von Beiträgen

Alle KI-Anwendungen von Plattformen wie Staffbase sind als minimales bzw. begrenztes Risiko eingestuft.

Was diese Anwendungen gemeinsam haben: Sie treffen keine Entscheidungen über Mitarbeitende, werten keine biometrischen Daten aus und beeinflussen keine Karrieren oder Chancen. Sie helfen dabei, Wissen schneller zugänglich zu machen und Kommunikation effizienter zu gestalten.

Eine wichtige Einschränkung gilt jedoch auch hier: Ein niedriges Risiko nach dem EU AI Act bedeutet nicht automatisch Compliance. Sobald personenbezogene Daten verarbeitet werden, etwa wenn ein KI-Assistent auf Mitarbeiterprofile zugreift oder Nutzungsverhalten auswertet, ist die DSGVO im Spiel. Auf das geringste Risiko nach dem EU AI Act folgt also nicht zwingend der geringste Aufwand beim Datenschutz.

Warum ist Governance für KI im Intranet entscheidend? Und warum geht es dabei meist um die DSGVO?

Viele Unternehmen denken, Datenschutz sei bereits unter Kontrolle, weil sie seit Jahren DSGVO-konform arbeiten. Das ist ein teurer Irrtum, denn KI verändert die Datenschutzlage grundlegend, ohne dass sich das Gesetz geändert hat.

Das Kernproblem liegt in der Zweckbestimmung. Die DSGVO erlaubt die Verarbeitung personenbezogener Daten nur für genau den Zweck, für den sie erhoben wurden. Wer beispielsweise Mitarbeiterdaten für die Gehaltsabrechnung erhebt und diese dann in ein KI-System einspeist, das damit etwas ganz anderes macht, verlässt schnell den ursprünglichen Erlaubnistatbestand – oft ohne es zu merken. KI-Systeme weiten die Zweckbestimmung bestehender Daten erheblich aus. Das ist der Datenschutz, an den viele nicht denken.

Die DSGVO folgt dem Prinzip: Verarbeitung ist grundsätzlich verboten, es sei denn, es gibt eine Rechtsgrundlage. Für KI im Unternehmenskontext kommen vor allem zwei in Frage: Einwilligung und berechtigtes Interesse. Beide sind im KI-Kontext problematisch. Eine Einwilligung kann jederzeit widerrufen werden. Wenn personenbezogene Daten aber bereits in ein KI-Modell eingeflossen sind, lässt sich das kaum rückgängig machen. Beim berechtigten Interesse muss sorgfältig abgewogen werden, ob das Unternehmensinteresse wirklich das Interesse der betroffenen Person überwiegt. Das ist keine Formalität, sondern eine echte Einzelfallprüfung.

Dazu kommen drei weitere Pflichten, die Unternehmen beim KI-Einsatz beachten müssen:

Eine klare Rechtsgrundlage für die Datenverarbeitung.

Eine transparente Information der Betroffenen darüber, wie und wofür ihre Daten eingesetzt werden, auch im KI-Kontext.

Die Frage der Verantwortlichkeit: Wer Daten in ein KI-System eines Drittanbieters einspeist, tritt unter Umständen in eine gemeinsame Verantwortlichkeit mit diesem Anbieter ein, was eigene vertragliche und organisatorische Konsequenzen hat.

Datenschutz ist durch KI keine einfachere Aufgabe geworden. Es reicht nicht mehr, Verarbeitungsverzeichnisse zu pflegen und Standarderklärungen einzuholen. KI erfordert, dass Unternehmen ihre bestehende Datenschutzpraxis neu bewerten, besonders dort, wo Daten in Systeme fließen, deren Zweck ursprünglich ein ganz anderer war.

Wer haftet, wenn KI im Unternehmen Fehler macht?

KI ist keine Ausrede für Fehler. Das gilt als Grundsatz. Alles, was ein KI-System ausgibt und Mitarbeitende ungeprüft verwenden, wird dem Unternehmen zugerechnet. Die Frage ist nicht, ob die KI einen Fehler gemacht hat, sondern ob das Unternehmen alles Nötige getan hat, um ihn zu verhindern.

Das führt direkt zur Schulungspflicht. Sie existiert unabhängig davon, ob der EU AI Act sie explizit vorschreibt, denn sie ergibt sich bereits aus der allgemeinen Organisationspflicht des Arbeitgebers. Wer Mitarbeitenden erlaubt, KI-Systeme dienstlich zu nutzen, auch frei verfügbare Tools wie ChatGPT oder Claude, ist verpflichtet, sie über Risiken aufzuklären und einzuweisen. Der eigentliche Grund dahinter ist kein uneigennütziger: Der Arbeitgeber schützt damit in erster Linie sich selbst. Kann ein Unternehmen nicht nachweisen, dass es seine Mitarbeitenden ausreichend geschult hat, haftet es für Fehler, die durch uninformierte KI-Nutzung entstehen.

Was zählt als ausreichende KI-Schulung?

Nicht die permanente Überwachung aller Mitarbeitenden, sondern klare Leitplanken. Ein schriftlicher Code of Conduct oder KI-Nutzungsleitfaden, festgehalten in einer Betriebsvereinbarung oder separaten Vereinbarung, reicht aus, um die Organisationspflicht zu erfüllen. Darin sollte geregelt sein, was erlaubt ist, was nicht, und dass KI-Ausgaben grundsätzlich zu prüfen sind. Viele Unternehmen haben genau das bereits umgesetzt: einen internen Nutzungsleitfaden, erarbeitet durch die fachlich zuständigen Abteilungen.

Wichtig dabei: Ein Leitfaden auf Papier reicht nicht, wenn er in der Praxis ignoriert wird.

Wer weiß, dass Mitarbeitende entgegen der Regeln handeln und nicht einschreitet, verliert den Schutz, den der Leitfaden bieten soll. Organisatorische Maßnahmen müssen von technischen Maßnahmen flankiert werden, nicht umgekehrt.

Für die KI selbst gilt außerdem: Sie sollte so konfiguriert sein, dass sie bei unsicheren Antworten lieber keine Aussage macht als eine falsche. Und wenn sie antwortet, sollte sie die Quelle transparent machen, damit Mitarbeitende das Ergebnis einschätzen und bei Bedarf nachprüfen können.

Müssen KI-generierte Inhalte im Intranet gekennzeichnet werden?

Die Kennzeichnungspflicht ist eine der Fragen, die in der Praxis am häufigsten gestellt wird. Die Antwort ist differenzierter als viele erwarten.

Der EU AI Act schreibt Kennzeichnung dort vor, wo KI-Output so realistisch ist, dass Menschen ihn nicht mehr von echten Inhalten unterscheiden können. Der klassische Fall sind täuschend echte Bilder oder synthetische Videos. Wer solche Inhalte erzeugt und verbreitet, muss kenntlich machen, dass sie KI-generiert sind. Das gilt auch im internen Kontext.

Bei Texten ist die Lage weniger eindeutig. Es gibt keinen Prozentwert, ab dem ein Text als „mit KI-geschrieben“ gilt. In der Praxis zählt eher die Frage nach der Verantwortung: Wer einen Text veröffentlicht, egal ob er vollständig, teilweise oder gar nicht von KI stammt, steht dafür gerade. KI ist keine Entschuldigung für fehlerhafte Inhalte, und sich später darauf zu berufen, die KI habe es so formuliert, ist in der Regel keine tragfähige Verteidigung.

Gilt das Recht am eigenen Bild auch für KI-generierte Inhalte/Bilder?

Besonders relevant im Intranet-Kontext: KI-generierte Bilder, auf denen Mitarbeitende oder andere Personen erkennbar abgebildet sind, unterliegen dem Recht am eigenen Bild. Das ist kein neues Gesetz, sondern eine über hundert Jahre alte Regelung, die auf KI-Bilder genauso angewendet wird wie auf Fotografien oder Illustrationen. Entscheidend ist allein, ob eine Person für Dritte erkennbar ist. Ist das der Fall, braucht es eine Einwilligung, unabhängig davon, ob das Bild bearbeitet, gezeichnet oder KI-generiert wurde.

Für die Umsetzung im Unternehmen gibt es zwei Wege. Der erste ist technisch: Einige KI-Tools kennzeichnen die mit ihnen generierten Inhalte automatisch – entweder sichtbar oder zumindest in den Metadaten. Der zweite ist organisatorisch: Mitarbeitende werden über ihre Kennzeichnungspflichten informiert und im Code of Conduct oder Nutzungsleitfaden dazu verpflichtet. Beide Wege schließen sich nicht aus, sondern können sich ergänzen.

Wie verändert der EU AI Act die Rolle des Intranets als Wissensquelle?

KI ist nur so gut wie die Informationen, auf denen sie basiert. Das klingt wie eine technische Selbstverständlichkeit, ist aber in der Praxis die eigentliche Schwachstelle vieler Unternehmen, die KI im Intranet einsetzen wollen.

Ein KI-Assistent, der Mitarbeitenden Fragen zu Urlaubstagen, internen Prozessen oder Richtlinien beantwortet, greift auf das zurück, was im Intranet steht. Ist das Wissen veraltet, widersprüchlich oder unvollständig, gibt die KI veraltete, widersprüchliche oder unvollständige Antworten – und zwar mit voller Überzeugung. Das ist das eigentliche Risiko, nicht das Modell selbst. Mitarbeitende, die auf Basis einer falschen KI-Antwort handeln, tragen die Konsequenz. Und das Unternehmen haftet dafür, wenn es die Grundlage nicht sichergestellt hat.

Das bedeutet: Wer KI verantwortungsvoll im Intranet einsetzen will, muss zuerst das Intranet selbst in Ordnung bringen. KI macht Wissenslücken nicht kleiner, sie macht sie sichtbarer und teurer.

Konkret braucht KI im Unternehmenskontext drei Dinge:

Inhalte, die aktuell und geprüft sind

Klare Verantwortlichkeiten dafür, wer welche Inhalte pflegt und freigibt

Und eine Plattform, die KI auf genau diese kuratierten Quellen beschränkt – nicht auf alles, was irgendwo abgelegt ist

Der beste Weg, um sicherzustellen, dass eine KI keine falschen Antworten gibt, ist, sie gar nicht erst antworten zu lassen, wenn sie es nicht sicher weiß. Und ihr die Quelle mitzugeben, wenn sie antwortet, damit Mitarbeitende die Antwort einordnen und bei Bedarf selbst nachprüfen können.

Das Intranet verändert sich durch KI von einem Ablageort für Dokumente zu einer aktiven Wissensquelle, aus der Antworten generiert werden. Diese Verschiebung macht Content Governance zu einer Compliance-Frage, nicht nur zu einer redaktionellen.

Wie hilft Staffbase Unternehmen, KI im Intranet verantwortungsvoll einzusetzen?

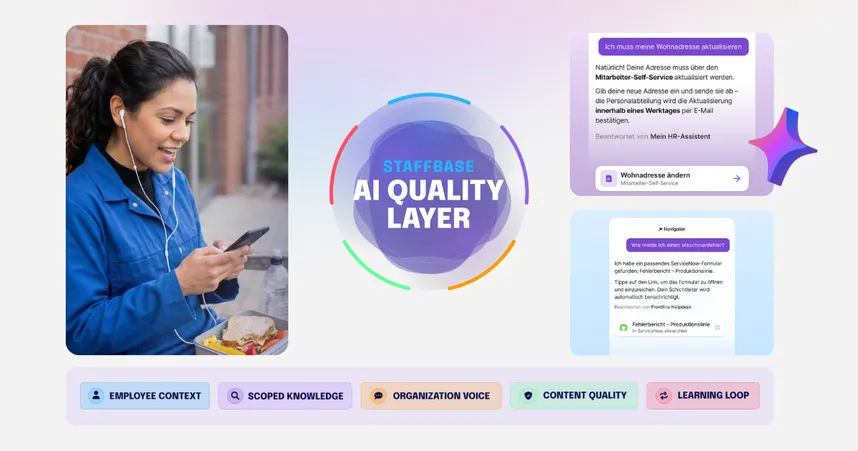

Staffbase hilft Unternehmen, KI verantwortungsvoll im Intranet einzusetzen, indem die Plattform Governance als Voraussetzung behandelt, nicht als nachträgliche Absicherung. KI-Antworten basieren ausschließlich auf geprüften, aktuellen und freigegebenen Inhalten, Daten bleiben in der geschützten Unternehmensumgebung, und der KI-Assistent zeigt immer die Quelle seiner Antwort.

Die Frage, die sich aus allem bisher Gesagten ergibt, lautet nicht: Welche KI-Funktionen bietet Staffbase? Sondern: Wie stellen wir sicher, dass KI im Intranet tatsächlich richtige Antworten liefert und nicht nur plausible?

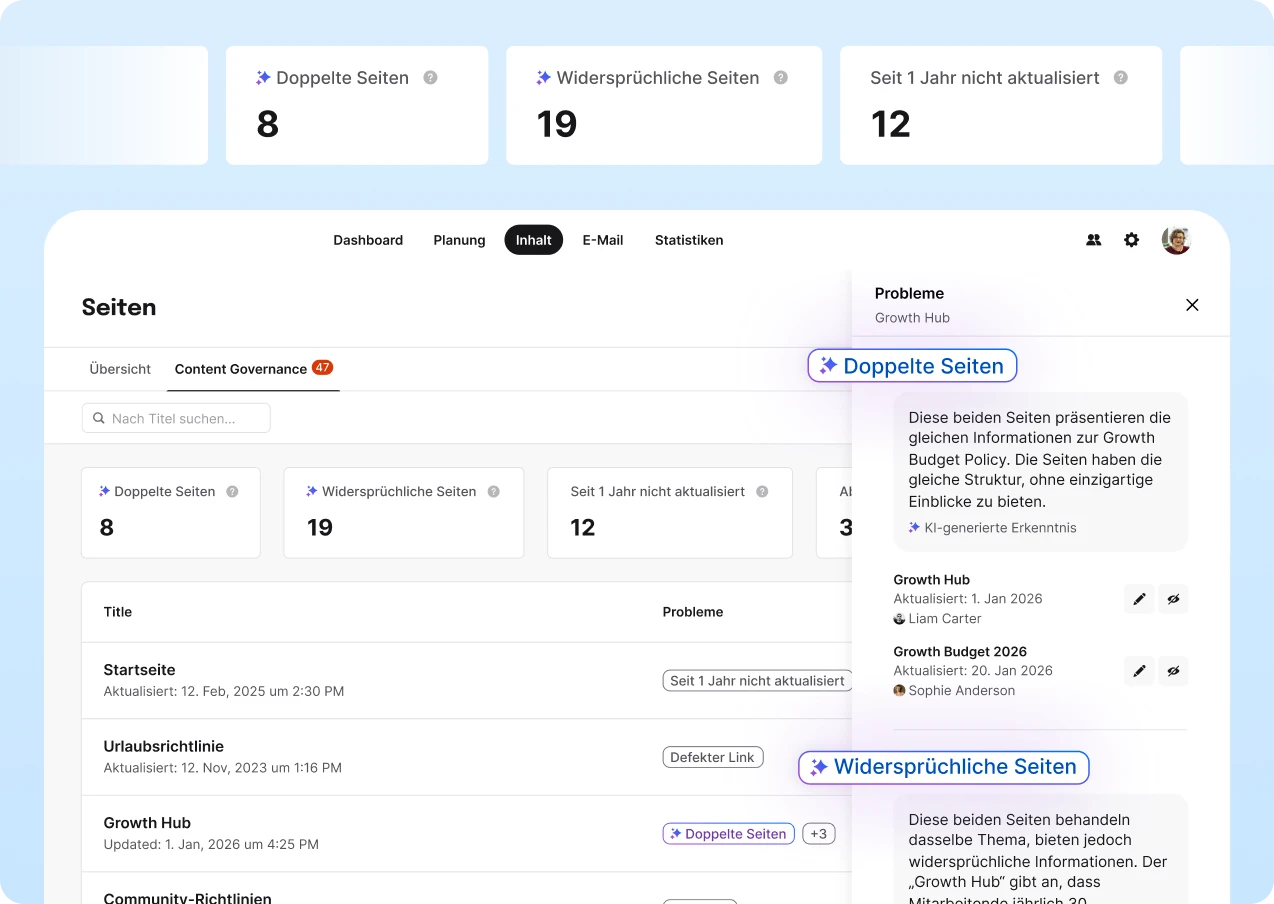

Die Antwort beginnt vor der KI, nicht mit ihr. Mit Content Pro löst Staffbase zuerst das Datenproblem: Das Add-on prüft das Intranet kontinuierlich auf veraltete, doppelte oder widersprüchliche Inhalte, meldet fehlende Verantwortliche und defekte Links und schafft damit die Grundlage, auf der KI verlässlich arbeiten kann. Inhalte haben Eigentümer, Ablaufdaten und Freigabeprozesse, nicht weil das regulatorisch gefordert ist, sondern weil KI ohne diese Grundlage keine verlässlichen Antworten geben kann. Wer eine KI auf einen Dokumentenfriedhof loslässt, automatisiert Verwirrung, keine Effizienz.

Zentralisierte Governance mit Staffbase Content Pro

Zentralisierte Governance mit Staffbase Content Pro

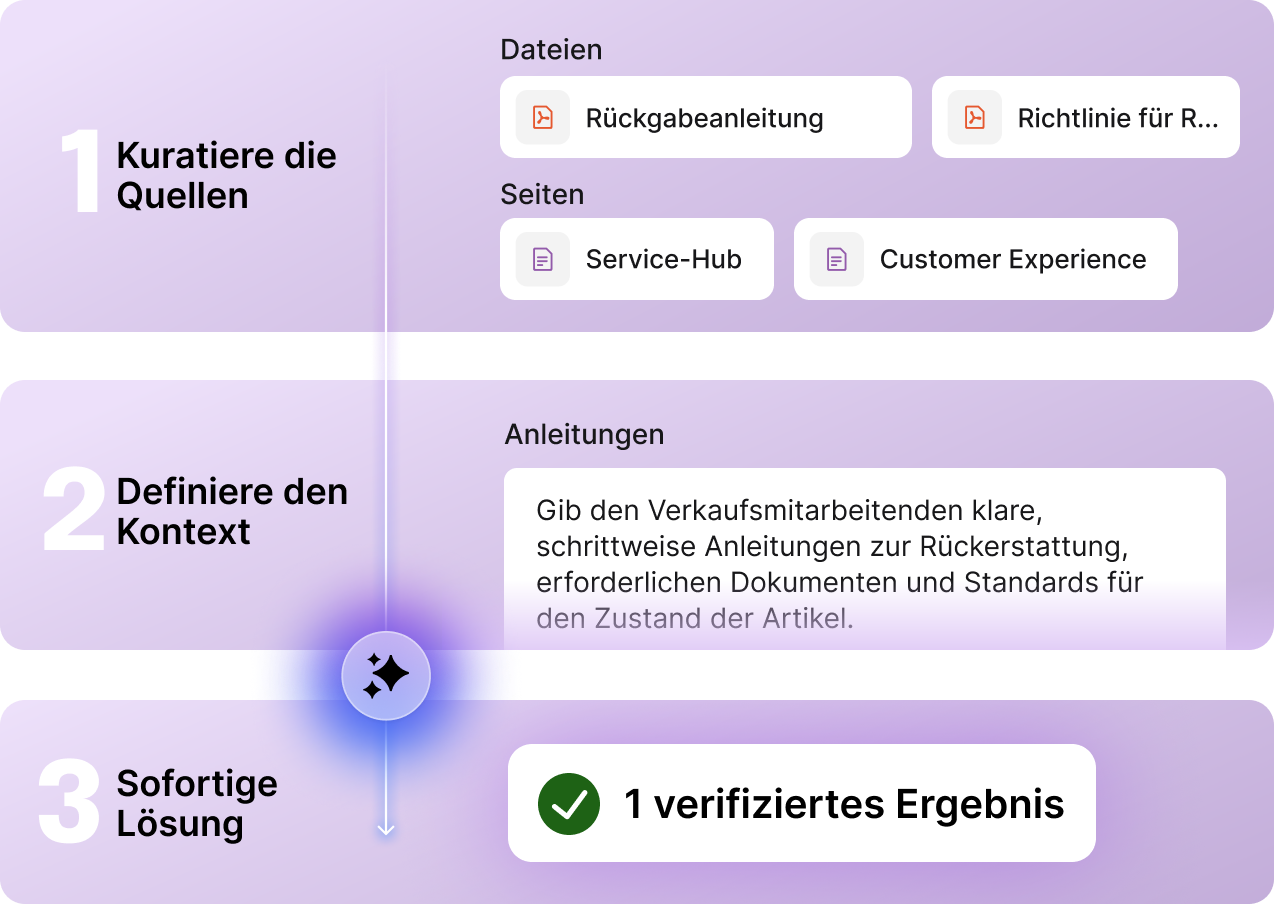

Darauf aufbauend liefert der Staffbase Navigator als KI-Assistent direkte, rollenspezifische Antworten, basierend auf kuratierten Unternehmensquellen, mit Quellenangabe und ohne langes Hin und Her. Wenn er sich nicht sicher ist, antwortet er lieber gar nicht. Das sollte nicht als Schwäche des Systems gesehen werden, sondern als dessen wichtigstes Merkmal. Dieselbe Logik gilt für Staffbase On Air: Der KI-Podcast verwandelt bereits veröffentlichte und freigegebene Intranet-Inhalte in personalisierte Audio-Briefings – keine neuen Inhalte, keine externe Datenquellen, kein Kontrollverlust.

Die Governance-Möglichkeiten des KI-Assistenten Staffbase Navigator

Die Governance-Möglichkeiten des KI-Assistenten Staffbase Navigator

Für Unternehmen bedeutet das: Sie setzen KI auf einer Plattform ein, die Governance als Voraussetzung behandelt. Die KI-Daten bleiben in der geschützten Unternehmensumgebung, fließen nicht ab und werden nicht für das Training externer Modelle verwendet. Und Mitarbeitende bekommen Antworten, denen sie vertrauen können, weil die Plattform dahinter dafür ausgelegt ist, Vertrauen zu rechtfertigen.

Wie können Unternehmen KI im Intranet verantwortungsvoll einsetzen? Drei konkrete Schritte

Der pragmatische Ansatz beim Thema KI-Compliance lautet: Mit 20 Prozent des Aufwands lassen sich 80 Prozent der relevanten Compliance-Fragen abdecken. Das setzt voraus, dass man an den richtigen Stellen ansetzt.

1. Risikoklassifizierung zuerst – und dabei nicht bei der ersten Hürde aufhören

Der erste Schritt ist zu prüfen, in welche Risikokategorie die eigenen KI-Anwendungen fallen. Typische Intranet-KI landet dabei meist im minimalen oder begrenzten Risiko – das schafft Klarheit und Handlungsspielraum. Aber diese Einordnung ist nur der Anfang der Prüfung, nicht das Ende. Wer danach aufhört, hat die DSGVO noch nicht angeschaut. Und die greift unabhängig davon, wie das KI-System nach dem EU AI Act eingestuft ist.

2. Governance etablieren – schriftlich, konkret und durchgesetzt

Klare Regeln für den KI-Einsatz im Unternehmen sind keine bürokratische Pflicht, sondern Eigenschutz. Das bedeutet: festhalten, welche KI-Systeme eingesetzt werden dürfen, unter welchen Bedingungen und mit welchen Pflichten für Mitarbeitende – insbesondere die Pflicht, KI-Ausgaben zu prüfen. Ein Nutzungsleitfaden oder Code of Conduct sollte technisch flankiert werden, nicht nur auf dem Papier existieren. Und er muss tatsächlich durchgesetzt werden.

3. KI auf vertrauenswürdige Wissensquellen aufbauen

KI ist nur so zuverlässig wie die Inhalte, auf denen sie basiert. Veraltete, widersprüchliche oder unkontrollierte Dokumente machen KI nicht nur weniger nützlich – sie machen sie zum Haftungsrisiko. Wer KI im Intranet verantwortungsvoll einsetzen will, muss zuerst sicherstellen, dass das Intranet selbst als Wissensquelle taugt: mit klaren Verantwortlichen für Inhalte, Freigabeprozessen und regelmäßiger Aktualisierung.

Regulierung entwickelt sich weiter. Was heute als sicherer Rahmen gilt, kann morgen durch neue Rechtsprechung oder Anpassungen der Verordnung überholt sein. Unternehmen sollten ihre KI-Strategie deshalb nicht einmalig aufsetzen und dann liegen lassen, sondern regelmäßig überprüfen – genauso wie sie es mit ihrer Datenschutzpraxis tun sollten. Wer heute pragmatisch vorgeht, vorläufige Entscheidungen trifft und bereit ist, sie zu revidieren, ist besser aufgestellt als wer wartet, bis alle Fragen abschließend geklärt sind. Denn das werden sie so schnell nicht sein.

Das Wichtigste auf einen Blick

KI im Intranet ist unter dem EU AI Act in den meisten Fällen erlaubt, weil typische Anwendungen wie KI-Assistenten oder intelligente Suche in die niedrigsten Risikokategorien fallen. Die strengsten Regeln treffen Systeme, die über Menschen entscheiden oder sie verdeckt beeinflussen. Das ist nicht das, wofür Intranet-KI gebaut wird.

Die eigentliche Compliance-Herausforderung ist eine andere: Die DSGVO greift immer dann, wenn personenbezogene Daten verarbeitet werden. Das ist bei KI im Unternehmenskontext fast immer der Fall. Wer nur den EU AI Act prüft, hat die falsche Frage gestellt.

Konkret bedeutet das für Unternehmen, dass sie KI-Systeme klassifizieren, Governance etablieren, Mitarbeitende schulen, KI auf geprüfte Wissensquellen aufsetzen und die eigene KI-Strategie regelmäßig überprüfen müssen. Denn was heute gilt, kann morgen schon überholt sein.

Neugierig, wie Staffbase sicherstellt, dass KI im Intranet verantwortungsvoll und regelkonform eingesetzt wird? Erfahre in einer persönlichen Demo, wie Content Pro, Navigator und On Air zusammenarbeiten — auf einer Plattform, die Governance als Grundlage behandelt.

Die Einschätzungen und rechtlichen Hinweise in diesem Artikel basieren auf dem Webinar „Ask Me Anything: EU AI Act, DSGVO & KI im Intranet“, das Staffbase mit externen IT-Anwält*innen durchgeführt hat. Die Expert*innen sind auf IT-Recht, EU AI Act und DSGVO spezialisiert und beraten Unternehmen zu diesen Themen in der Praxis. Dieser Artikel ersetzt keine individuelle Rechtsberatung.