Der AI Quality Layer: Damit KI wirklich für alle Mitarbeitenden funktioniert

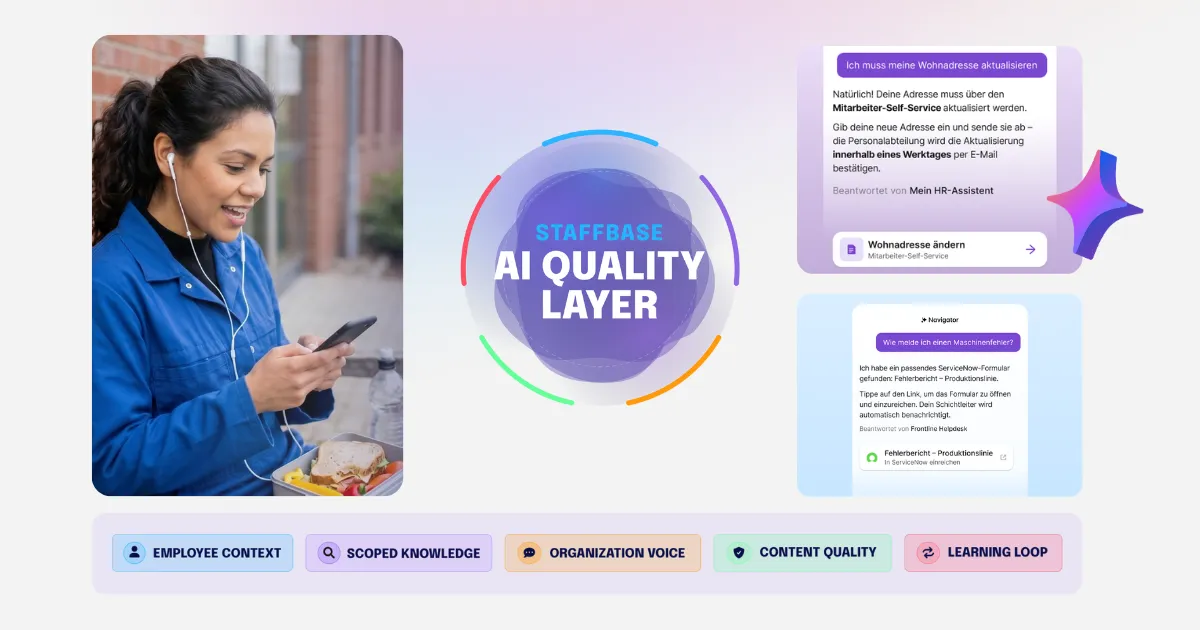

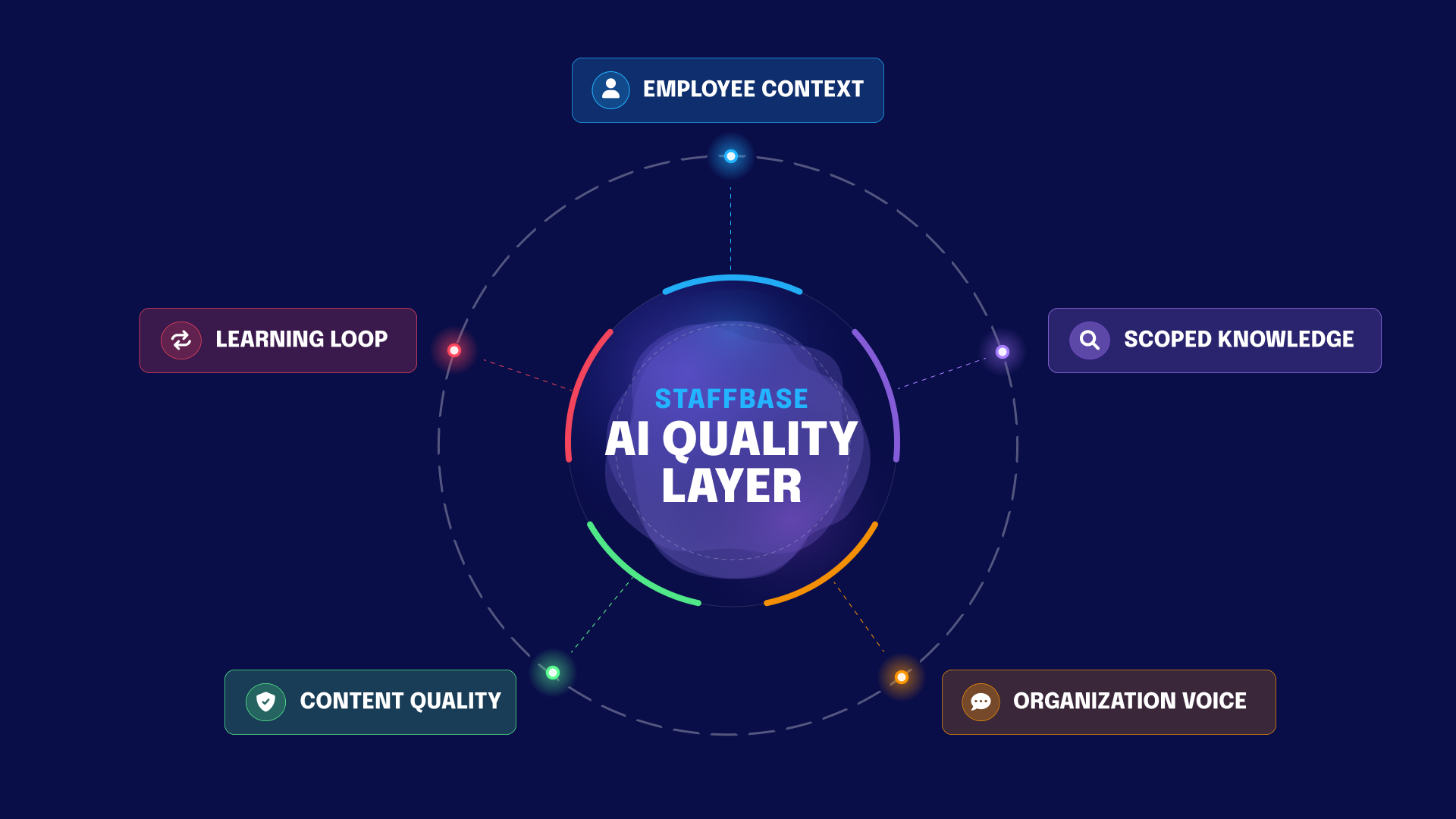

KI-Sicherheit ist eine absolute Grundvoraussetzung. Die wahre Herausforderung besteht darin, jede Antwort präzise, kontextbezogen und vertrauenswürdig zu machen. Der AI Quality Layer löst dieses Problem durch fünf miteinander verbundene Dimensionen.

Das Wichtigste in Kürze

Ein System kann über eine hohe KI-Sicherheit verfügen und dennoch Antworten liefern, die nur „fast richtig“ sind. Das reicht im Arbeitskontext aber schlichtweg nicht.

Der Staffbase AI Quality Layer löst dieses Problem durch fünf Dimensionen: Er weiß, wer fragt (Employee Context), durchsucht nur relevante Inhalte (Scoped Knowledge), klingt nach deinem Unternehmen (Organization Voice), hält die Quellen sauber und aktuell (Content Quality) und verbessert sich im Laufe der Zeit (Learning Loop).

Entscheidend ist: Diese Mechanismen sind tief in der Staffbase Employee-Experience-Plattform verankert und prägen jede KI-gestützte Interaktion: ob Intranet, Mitarbeiter-App, KI-Assistent, Echtzeit-Übersetzungen oder Content-Erstellung. Überall gilt derselbe Qualitätsstandard, für alle Mitarbeitenden.

Unser Ziel ist eine KI, die nicht nur sicher genug für den Einsatz ist, sondern so gut, dass ihr unternehmensweit alle vertrauen.

Was ist der Unterschied zwischen sicherer KI und guter KI?

Die Diskussion über KI in Unternehmen verläuft nach einem vorhersehbaren Muster. Am Anfang war die Begeisterung groß über leistungsstarke Modelle und scheinbar grenzenlose Möglichkeiten. Doch als die erste Euphorie verflogen war, machten sich Unsicherheit und Skepsis breit: „Was ist mit Datenschutz, Compliance und Haftungsrisiken?“

Aus dieser Sorge heraus entstand eine ganze Governance-Branche rund um eine einzige Frage: Ist die KI sicher?

Datenzugriffskontrollen, Berechtigungskonzepte, Compliance-Frameworks, Vertraulichkeitskennzeichnungen, Sandboxes: Alle großen Plattformen sind darauf ausgelegt, zu verhindern, dass die KI unbefugte Inhalte abruft, vertrauliches Wissen preisgibt oder geschützte Informationen offenlegt.

Das ist richtig und wichtig. Kein Unternehmen sollte KI ohne diese Grundlagen einsetzen. Aber du kannst jede Security- und Compliance-Vorgabe vorbildlich erfüllt haben und trotzdem liefert die KI nur fast richtige Antworten. Eine Übersetzung, die technisch korrekt ist, aber nichts nach deinem Unternehmen klingt. Ein Zitat aus einer Richtlinie, die zwar letzten Monat noch aktuell war, aber nicht die gestern aktualisierte Version berücksichtigt. Eine Zusammenfassung, welcher der Kontext fehlt, der sie für dieses konkrete Team nützlich macht.

Fast richtig. Nicht falsch genug, um es sofort zu bemerken. Aber auch nicht richtig genug, um sich darauf verlassen zu können.

Oder wie unser CEO Martin Böhringer es bei der VOICES 2026 gesagt hat:

„Fast richtig reicht bei der Arbeit nicht. Im Privatleben kann fast richtig in Ordnung sein. Im Arbeitskontext erzeugt fast richtig Risiken. Es untergräbt Vertrauen. Es bringt Menschen dazu, das Tool nicht mehr zu nutzen.“

Martin Böhringer, CEO, Staffbase, VOICES 2026

Das liegt daran, dass sich die Branche bisher darauf konzentriert hat, den Input der KI zu regulieren. Kaum jemand stellt die schwierigere Frage: „Ist das, was herauskommt, wirklich gut?“

Ist die Antwort präzise? Klingt sie nach deiner Organisation? Können Mitarbeitende nachvollziehen, woher die Information stammt? Kann das Unternehmen hinter allem stehen, was die KI in seinem Namen produziert?

ClearBox-Consulting-Gründer Sam Marshall verglich Governance bereits 2017 in einem Blogartikel mit den Bremsen eines Autos und zitierte dabei Ralph O’Brien:

„Gute Governance ist wie gute Bremsen an einem Auto – sie machen es sicherer, schneller zu fahren.“

Ralph O’Brien

Diese Analogie ist im Zeitalter der KI relevanter denn je. Aber Bremsen allein bringen dich nicht ans Ziel. Du brauchst auch Motor, Lenkung und Navigation. All das muss sicher und gut sein.

Genau deshalb haben wir den AI Quality Layer entwickelt.

Was ist der AI Quality Layer?

Der AI Quality Layer ist das System, das zwischen dem KI-Modell und den Mitarbeitenden steht. Er umfasst alle Prüfungen, Kontexte und Kontrollen, die sicherstellen, dass die Ergebnisse der KI wirklich vertrauenswürdig sind, bevor sie jemand zu Gesicht bekommt.

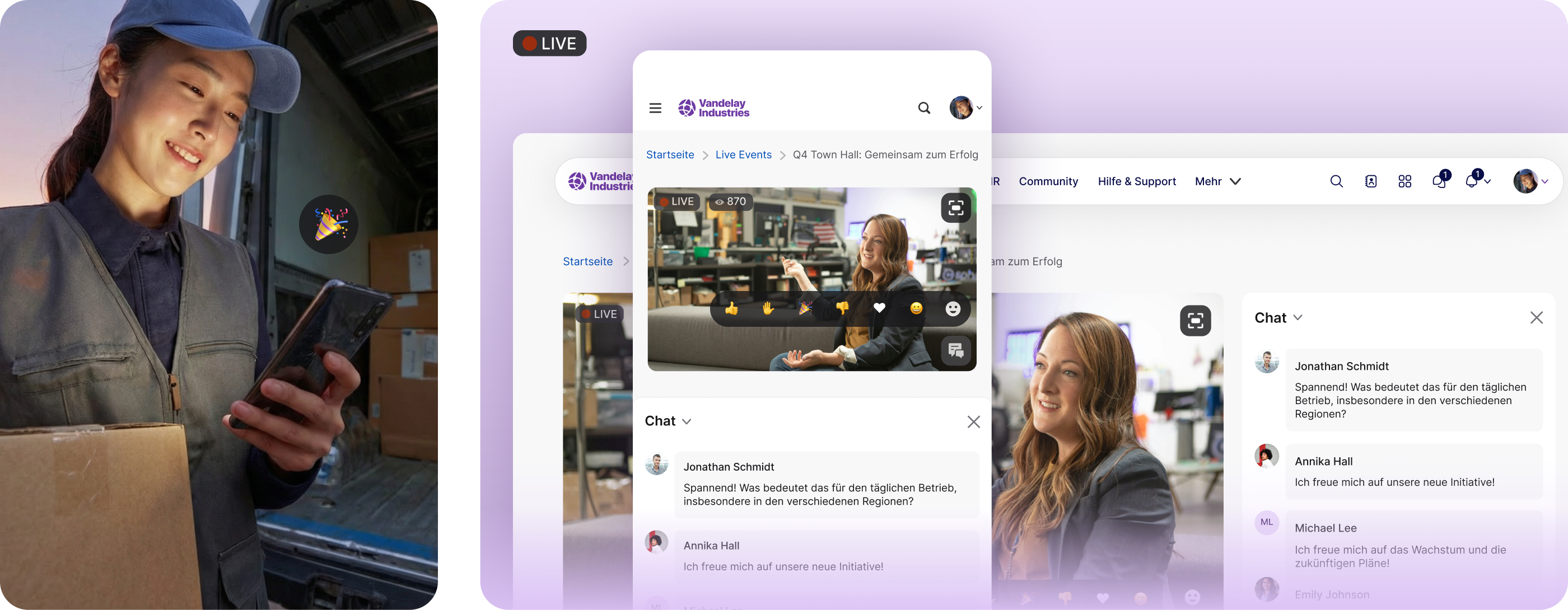

Es handelt sich nicht um ein einzelnes Feature, sondern um fünf ineinandergreifende Dimensionen. Sie greifen bei jeder KI-gestützten Interaktion in Staffbase ineinander: von Navigator-Antworten über Echtzeit-Untertitel von Town Halls, die automatisch in Zielsprachen übersetzt werden, bis zu KI-generierten Briefings und KI-gestützter Inhaltserstellung. Drei dieser Dimensionen greifen bei jeder Anfrage in Echtzeit. Zwei weitere sorgen dafür, dass sich das System kontinuierlich verbessert.

Der Name ist ganz bewusst gewählt. Nicht „AI Governance Layer“ – denn Governance ist das, woran die Branche ohnehin schon arbeitet. Nicht „AI Trust Layer“ – denn Vertrauen ist ein Ergebnis, kein Mechanismus. „Quality“ benennt das eigentliche Ziel: Wir stellen sicher, dass der Output wirklich gut ist. Das Vertrauen folgt dann von ganz allein.

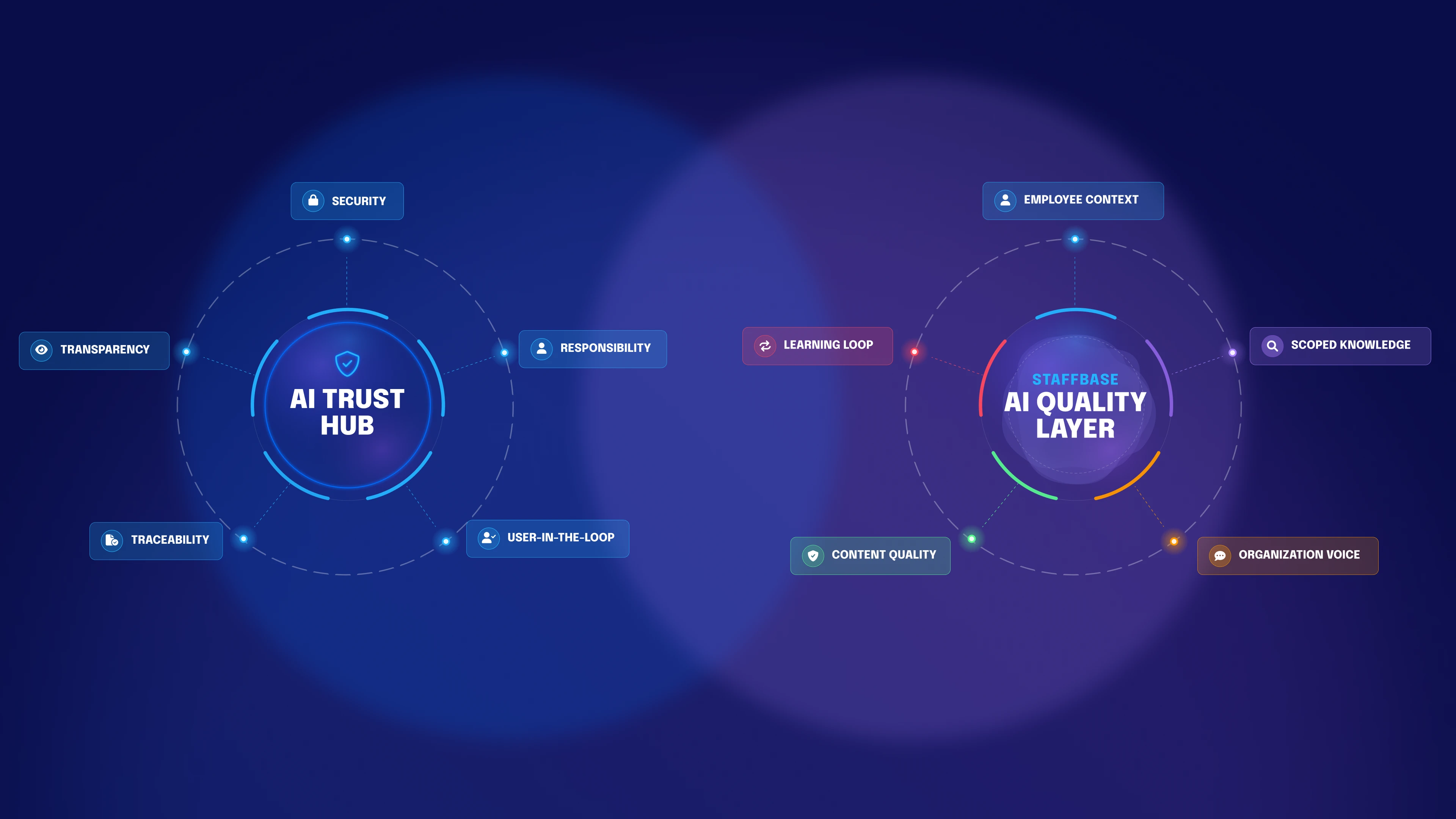

Das Fundament: AI Trust Hub

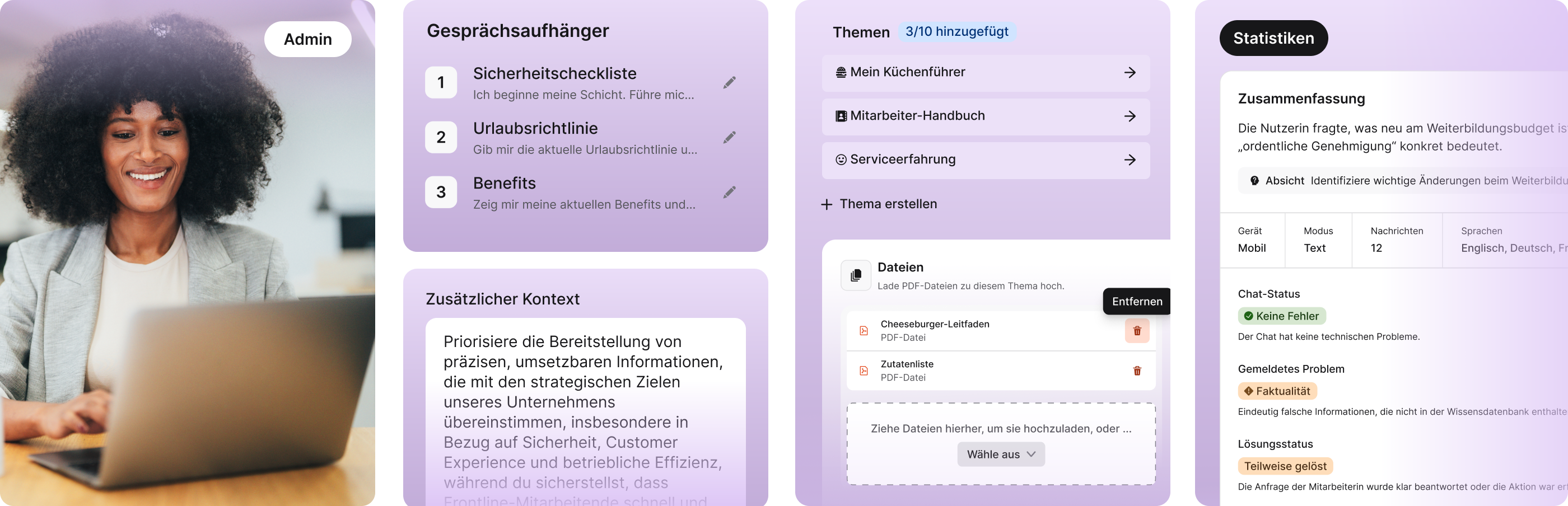

Vor der Qualität kommt die Sicherheit. Bei Staffbase bietet der AI Trust Hub eine zentrale Kontrolle über alle KI-Features der Plattform. Admins sehen genau, wo und wie KI eingesetzt wird, können KI-Funktionen pro Feature aktivieren oder deaktivieren und steuern, auf welche Daten die KI Zugriff hat.

Unser KI-Ansatz basiert auf den T.R.U.S.T.-Prinzipien: Transparency (Transparenz), Responsibility (Verantwortung), User-in-the-loop (Nutzerkontrolle), Security (Sicherheit), Traceability (Nachvollziehbarkeit). Sie sind fest in der Funktionsweise der Plattform verankert:

Alle Datenverarbeitungen laufen auf Microsoft Azure.

Kundendaten werden nicht für das Training von Modellen verwendet.

Prompts und Ausgaben sind verschlüsselt, werden nicht mit anderen Kunden geteilt und sind für Dritte nicht zugänglich.

Darüber hinaus respektiert die KI bestehende Inhaltsberechtigungen: Nutzer*innen können nur Inhalte generieren, die auf Informationen basieren, auf die sie ohnehin Zugriff haben. Das ist essenziell. Eine Mindestanforderung. Jede seriöse Plattform sollte das bieten. Die spannende Frage ist, was danach passiert: Wenn die KI sicher ist, wie stellst du sicher, dass sie auch wirklich gut ist?

Genau hier kommen die fünf Dimensionen ins Spiel.

Dimension | Die entscheidende Frage | Was gesteuert wird |

|---|---|---|

Employee Context | Wer fragt? | Rolle, Standort, Sprache und Verlauf prägen jede Antwort |

Scoped Knowledge | Woraus soll die KI schöpfen? | Zweckgebundene Assistenten mit kuratierten, freigegebenen Inhalten |

Organization Voice | Klingt es nach uns? | Terminologie, Markenstimme, Tonalität und Sprachregeln pro Space definiert |

Content Quality | Ist die Quelle wirklich zuverlässig? | Kontinuierliches Monitoring, Kennzeichnung und Bereinigung veröffentlichter Inhalte |

Learning Loop | Wird das System besser? | Feedback und Statistiken, die Antworten mit der Zeit verbessern |

1. Employee Context: Woher weiß die KI, mit wem sie spricht?

Eine KI, die nicht weiß, mit wem sie spricht, kann keine gute Antwort geben.

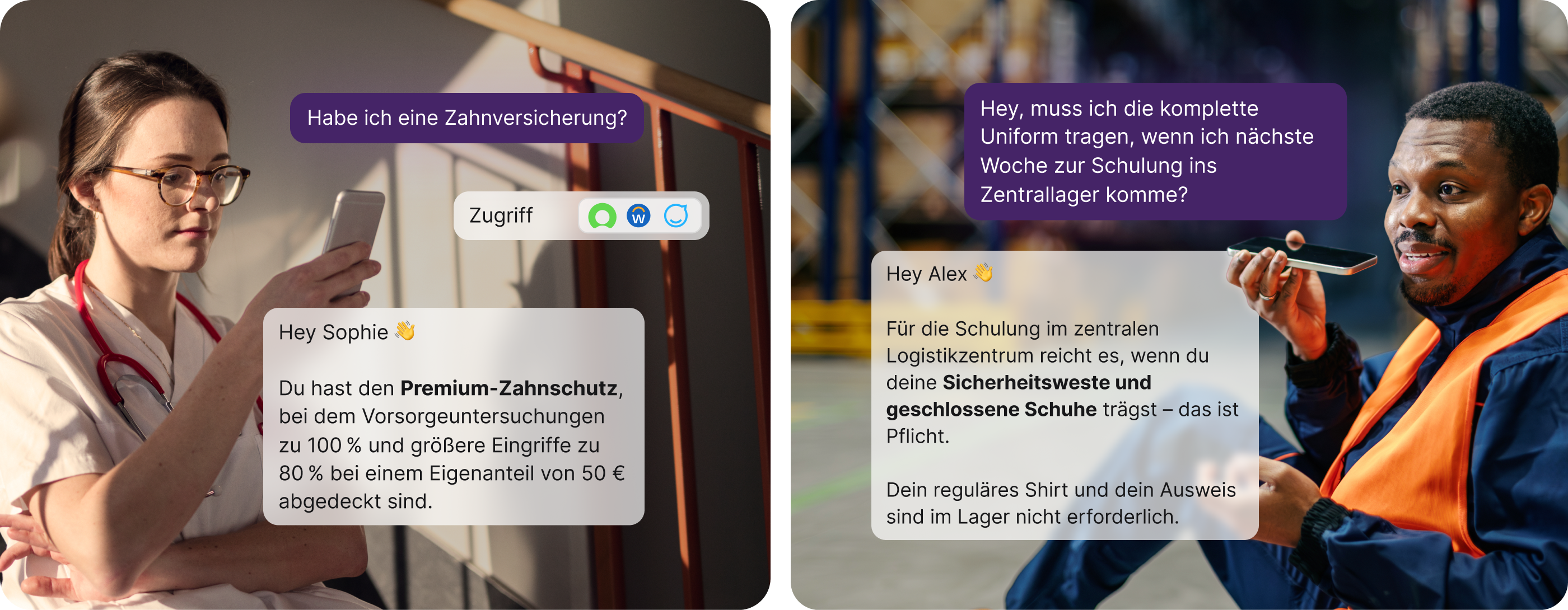

Stell dir Lena vor, eine Technikerin, die vor acht Tagen in einem Produktionswerk angefangen hat. Sie steht in der Werkshalle, ihre Uniform passt nicht richtig und sie muss eine andere Größe anfordern. Sie öffnet den KI-Assistenten des Unternehmens auf ihrem Smartphone und tippt eine Frage ein.

Der erste Versuch muss sitzen. Sie hat keinen zweiten Bildschirm, um Informationen abzugleichen, und keine Zeit, das Intranet zu durchsuchen. Sie braucht eine schnelle Antwort, der sie vertrauen und nach der sie sofort handeln kann.

Employee Context bedeutet: Das System erkennt die Person hinter der Frage. Es berücksichtigt individuelle Merkmale wie Rolle, Standort, Team und Sprache. Wenn Lena in Werk 3 in Bremen nach einem Verfahren fragt, weiß die KI, dass sie mit einer neuen Technikerin an genau diesem Standort spricht und nicht mit irgendeiner Person irgendwo im Unternehmen.

Personalisierung schärft die Präzision. Dieselbe Frage, einmal von einer Schichtarbeiter*in und einmal von einer Werksleitung gestellt, erfordert möglicherweise grundlegend andere Antworten mit unterschiedlichen Details, Umfängen und Auswirkungen.

Der Staffbase Quality Layer erfasst den relevanten Kontext aus früheren Interaktionen. So baut das System im Laufe der Zeit ein tieferes Verständnis auf. Die Antworten werden mit jeder Nutzung relevanter, ohne den Datenschutz zu gefährden oder Unternehmensgrenzen zu überschreiten.

2. Scoped Knowledge: Warum sollte KI nicht alles durchsuchen?

Einer der häufigsten Fehler bei KI in Unternehmen passiert, wenn das Modell zu breit sucht. Dann liefert es eine generische Antwort statt einer spezifischen, verlässlichen Lösung.

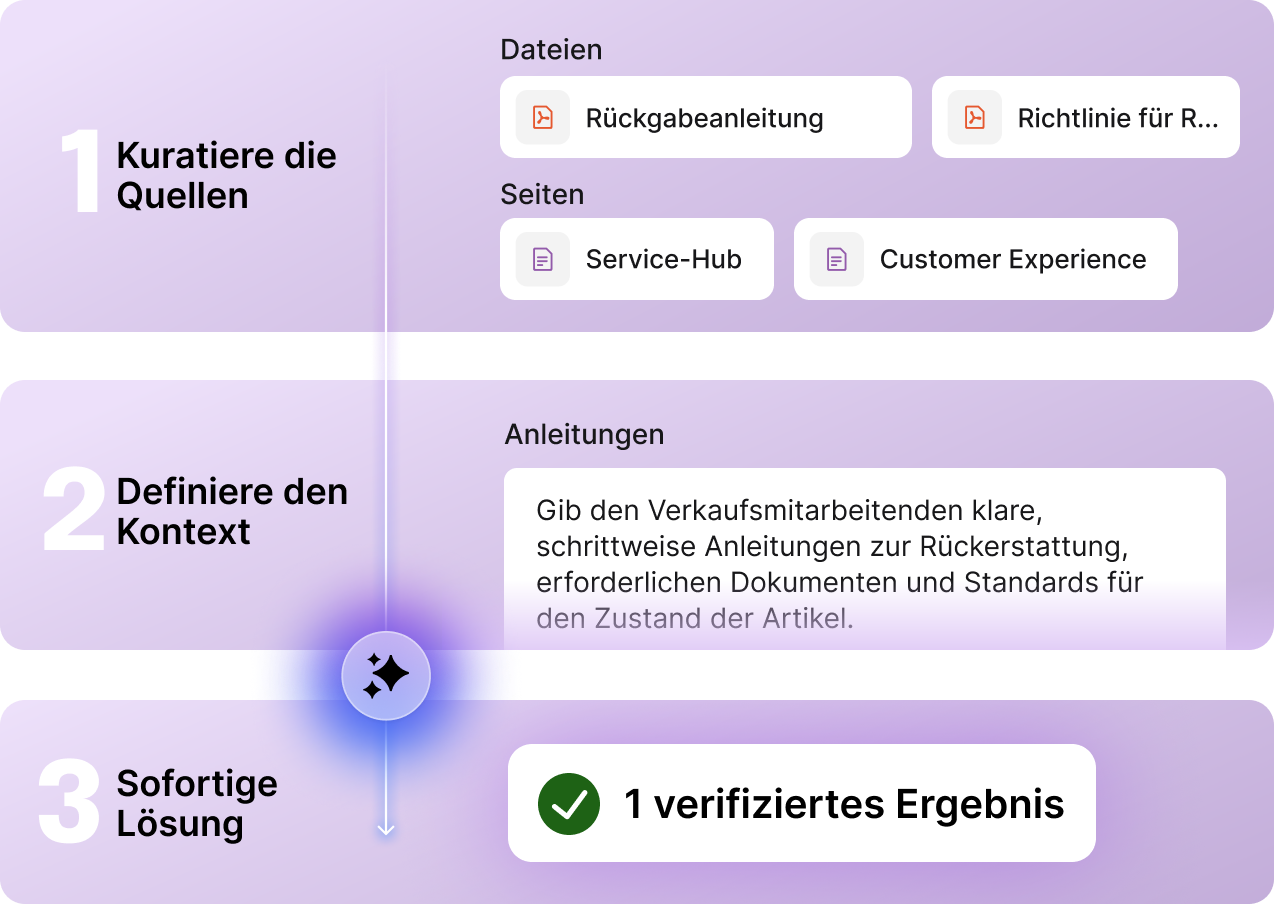

Jeder Plattformanbieter spricht davon, die KI mit „deinem gesamten Unternehmenswissen“ zu verknüpfen. Wir haben gelernt, dass genau das Gegenteil die besseren Ergebnisse liefert. Die KI nur mit dem richtigen Wissen zu verbinden, ist ein Qualitätsmerkmal, keine Einschränkung.

Wir nennen das Scoped Knowledge, also fokussiertes Wissen.

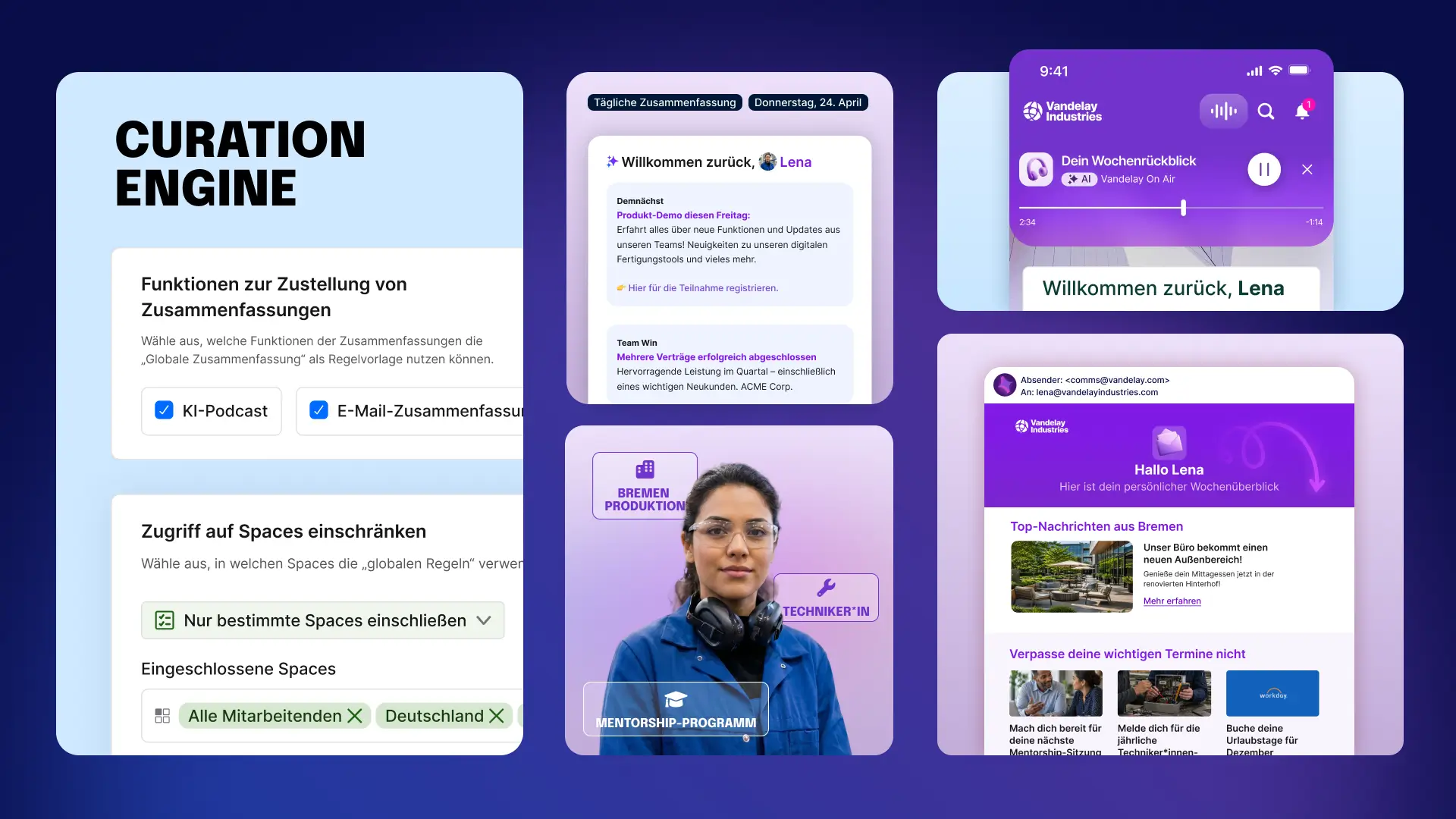

Genau das ermöglicht die Architektur der KI-Assistenten von Staffbase. Unternehmen erstellen passgenaue Assistenten, die jeweils über einen sorgfältig eingegrenzten Wissensbereich verfügen. Ein Facility-Assistent für Werk 3. Ein HR-Assistent für die DACH-Region. Ein Onboarding-Assistent für neue Mitarbeitende in der Logistik. Jeder von ihnen greift auf freigegebene, kuratierte Inhalte zu – und nur auf diese. Die Mitarbeitenden greifen weiterhin nur auf ein zentrales Interface zu, den Navigator. Und dieser triggert dann mithilfe seines Kontextwissens den korrekten spezialisierten Assistenten.

Die Branche zieht nach. ClearBox-Analysen zeigen, dass Anbieter von universellen Agenten zu themenspezifischen wechseln, weil niemand will, dass eine KI Fragen zur Urlaubsregelung auf Basis von Social-Feed-Kommentaren beantwortet oder die Regeln einer Region auf eine andere anwendet.

Der Staffbase Navigator verbindet sich mit Systemen wie ServiceNow, SharePoint, Workday und Confluence. Das Ziel ist nicht, diese Tools zu ersetzen. Wir machen ihre Inhalte über eine zentrale, vertrauenswürdige Oberfläche zugänglich. Die Eingrenzung bleibt dabei bestehen: Die KI weiß genau, welche Quelle sie für welche Art von Frage heranziehen muss.

3. Organization Voice: Wie klingt KI wie dein Unternehmen?

Eine korrekte Antwort, die klingt wie ein generischer Chatbot, ist trotzdem eine schlechte Antwort. Mitarbeitende merken sofort, wenn der KI-Output die falsche Terminologie, eine unpassende Tonalität oder falsche Namen für interne Programme verwendet. Jedes Mal, wenn das passiert, schwindet das Vertrauen.

Organization Voice bedeutet: Jede KI-Interaktion, jede Antwort, jede Übersetzung, jede generierte Seite ist abgestimmt auf die Kommunikationsweise deines Unternehmens. Bei Staffbase definieren wir das über KI-Kommunikationsrichtlinien: klare Sprachregeln, Einstellungen für Tonalität und Stil sowie Glossareinträge. Sie garantieren, dass die KI die richtigen Namen, Abkürzungen und Fachbegriffe nutzt.

Diese Richtlinien legst du pro Space fest. So können verschiedene Bereiche des Unternehmens bei Bedarf unterschiedliche Stimmprofile pflegen. Die Sicherheitskommunikation in einem Produktionswerk erfordert schließlich eine andere Sprache als der Nachbericht zum Town Hall.

Dabei wirkt Organization Voice über Chatbot-Antworten hinaus. Wenn ein Town Hall in Echtzeit in mehrere Sprachen untertitelt wird, nutzen die Untertitel die etablierten Übersetzungen des Unternehmens für Schlüsselbegriffe – nicht das, was ein generisches Modell produzieren würde. Wenn Inhalte mit KI-Unterstützung erstellt werden, klingen sie genau nach dieser Organisation.

Das ist der Unterschied zwischen einer KI, die für dein Unternehmen arbeitet, und einer, die nur bei dir im Einsatz ist.

4. Content Quality: Was passiert, wenn KI auf schlechte Inhalte trifft?

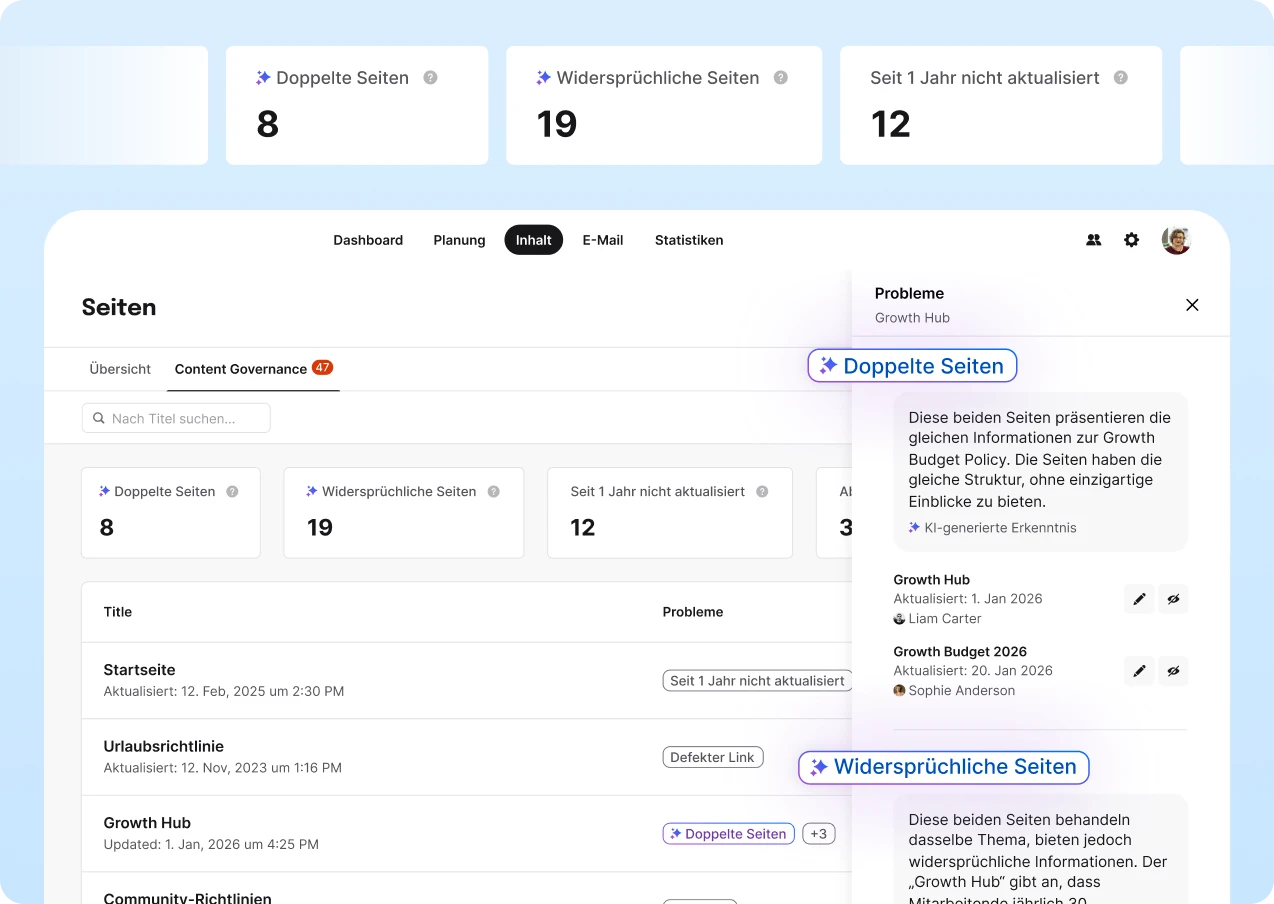

Diese Dimension entscheidet über Erfolg oder Misserfolg aller anderen. Die KI kann nur so gut sein wie die Inhalte, aus denen sie schöpft. Wenn die Quellen veraltet, widersprüchlich oder ohne klare Verantwortlichkeit sind, liefert die KI eine überzeugend klingende, aber falsche Antwort.

Und wie ClearBox-Gründer Sam Marshall treffend anmerkte, bringt KI jetzt Content-Probleme ans Licht, die Unternehmen jahrelang ignoriert haben. Organisationen, die sich nie um Governance gekümmert haben, werden plötzlich hellhörig. Denn KI verwandelt schlechte Inhalte in sichtbare Geschäftsrisiken.

Das Problem ist die Größenordnung. Große Unternehmen haben nicht nur eine technische, sondern auch eine riesige Content-Legacy. Manuelle Prüfprozesse haben laut ClearBox-Analysen selten Erfolg.

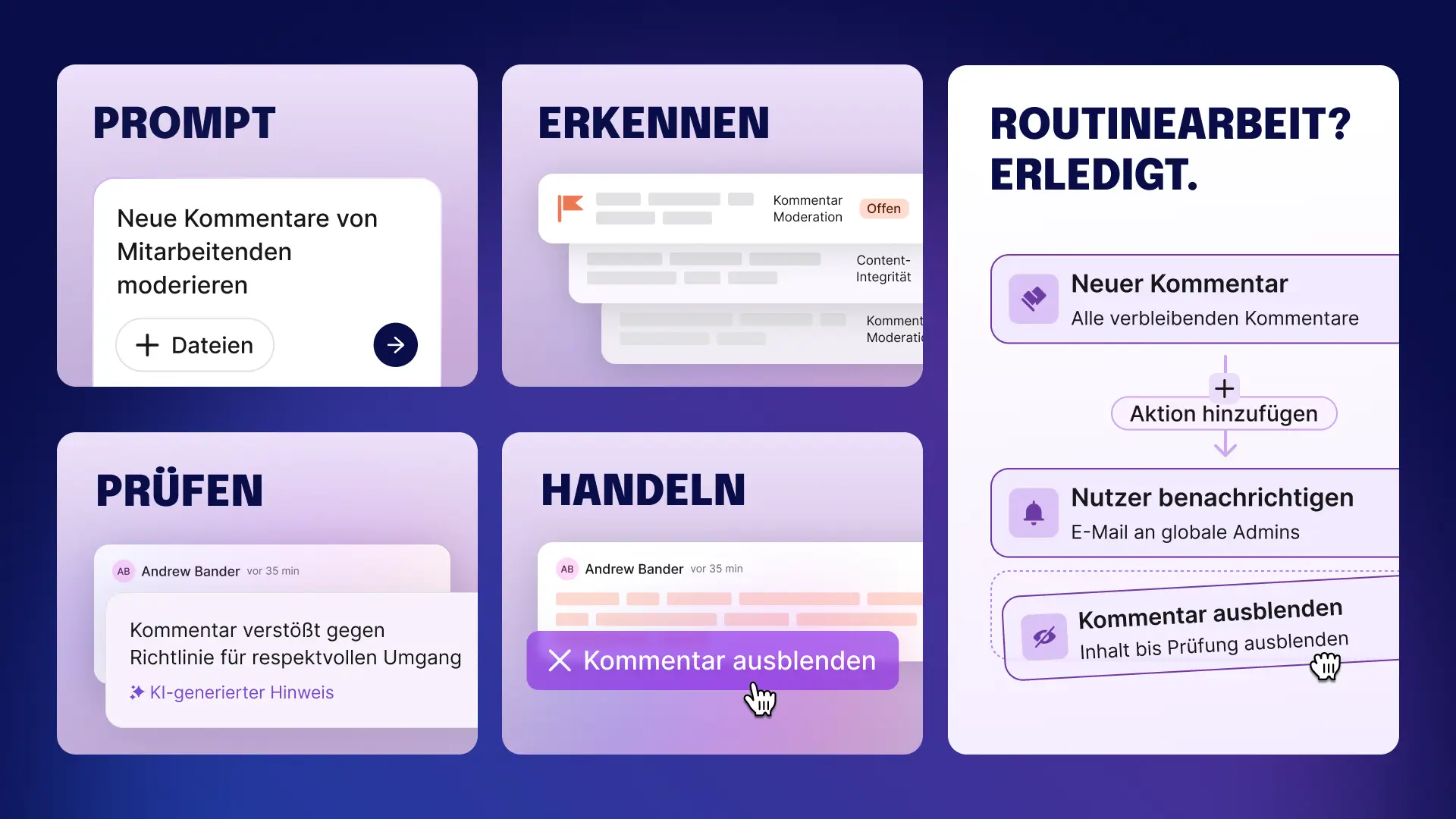

Hier kommt Content Pro ins Spiel. Der Bereich „Inhaltssteuerung" im Staffbase Studio überwacht veröffentlichte Seiten kontinuierlich und zeigt Probleme auf, die deine Aufmerksamkeit erfordern. Dazu gehören:

Seiten, die seit über einem Jahr nicht aktualisiert wurden

Abgelaufene Überprüfungserinnerungen

Inhalte ohne Aufrufe in den letzten 3 Monaten

Fehlerhafte Links

Zusätzlich erkennt Content Pro mithilfe von KI doppelte Inhalte und widersprüchliche Informationen innerhalb desselben Spaces. Für jedes markierte Problem erhalten Redakteur*innen direkt in ihrem Workflow konkrete Handlungsempfehlungen – kein separates Audit-Projekt, keine Tracking-Tabelle.

Der Staffbase Autopilot geht noch einen Schritt weiter: Er ersetzt regelmäßige manuelle Audits durch eine kontinuierliche, KI-gestützte Automatisierung, die im Hintergrund läuft. Und er erkennt automatisch inhaltliche Lücken, indem er Fragen von Mitarbeitenden identifiziert, auf die es noch keine Antworten gibt. Er markiert veraltetes Material, das du überprüfen oder aktualisieren solltest, und überwacht die Statistiken auf Anzeichen dafür, dass Inhalte bei den Mitarbeitenden nicht ankommen.

Die Content-Qualität ist vielleicht der am wenigsten glamouröse Teil im AI Quality Layer, aber sie ist definitiv der wichtigste. Ohne sie ist alles andere auf Sand gebaut.

5. Learning Loop: Wie wird das System besser?

Kein KI-System ist von Anfang an perfekt. Die entscheidende Frage ist, ob es sich verbessert und ob die Verantwortlichen sehen können, was funktioniert und was nicht.

Was bewirkt der Learning Loop?

Jede KI-Interaktion liefert umsetzbares Feedback. Admins können Navigator-Gespräche und KI-Interaktionen auswerten und verstehen, wo das System gut performt und wo es hakt. Sie können Muster erkennen, wie etwa Themen, bei denen die Antworten durchweg wenig hilfreich sind. Sie finden Fragen, die inhaltliche Lücken aufdecken, und identifizieren Momente, in denen Mitarbeitende die Interaktion abbrechen.

Das geht weit über einfache Nutzungsstatistiken hinaus. Es sind Governance-Statistiken – die Art, die ClearBox-Analysen als kritische Lücke in den meisten Plattformen identifizieren. Nicht nur Seitenaufrufe und Verweildauer, sondern: „Welche Content-Verantwortlichen müssen aktiv werden? Welche Seiten produzieren schlechte KI-Antworten? Wo stellen Mitarbeitende Fragen, die das System nicht beantworten kann?“

Der Learning Loop ist direkt mit den anderen vier Dimensionen verknüpft. Wenn Mitarbeitende an einem bestimmten Standort immer wieder nach einem Prozess fragen, der nicht dokumentiert ist, ist das ein klares Signal für die Content Quality. Wenn Antworten zu einer Richtlinie technisch korrekt sind, Mitarbeitende aber nicht danach handeln, könnte das ein Problem der Organization Voice sein – die Antwort stimmt, ist aber nicht hilfreich formuliert.

Jede Frage, die Mitarbeitende wie Lena stellen, und jede, die unbeantwortet bleibt, lehrt das System, was funktioniert und was nicht. Mit der Zeit schließt sich die Lücke zwischen „fast richtig“ und „wirklich richtig“, weil die organisationale Intelligenz dahinter schärfer wird.

Sicher und gut – für alle Mitarbeitenden

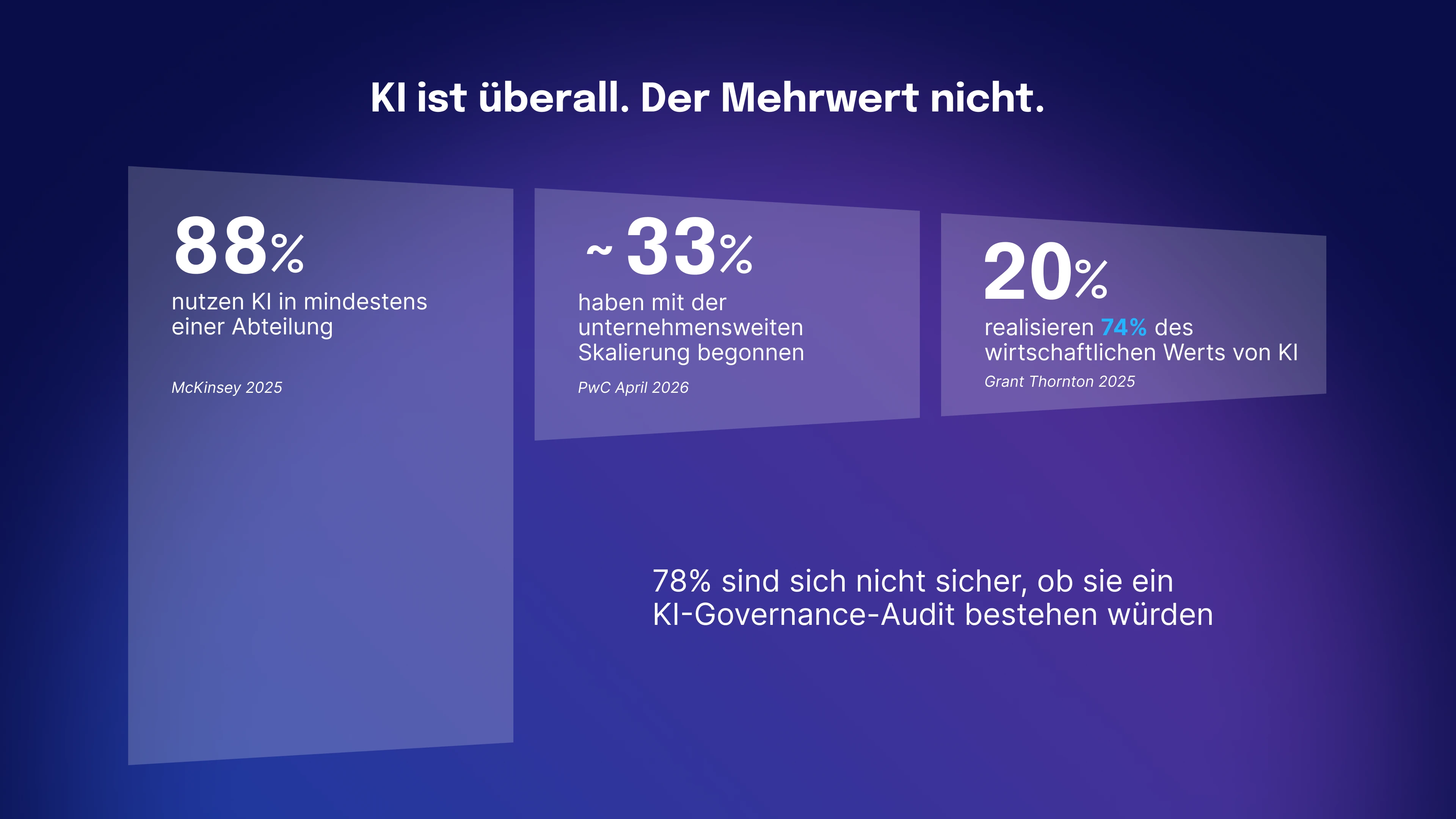

Die Zahlen sprechen für sich: 88 % der Unternehmen nutzen KI in mindestens einem Bereich. Aber nur ein Drittel hat damit begonnen, sie im gesamten Unternehmen zu skalieren. Und gerade einmal 20 % ziehen daraus einen signifikanten wirtschaftlichen Nutzen. Der Engpass ist nicht die Technologie. Es ist das Vertrauen.

Diese Lücke schließt sich nicht, weil Modelle besser werden. Modelle sind schon seit einer Weile gut genug. Die Lücke schließt sich, wenn Unternehmen darauf vertrauen können, dass alles, was die KI produziert – jede Antwort, jede Übersetzung, jedes Briefing – denselben Qualitätsstandard erfüllt, den sie an jede andere Unternehmenskommunikation anlegen würden.

Elf Jahre lang hat Staffbase die letzte Meile zu den Mitarbeitenden überbrückt, damit Unternehmen die ganze Belegschaft erreichen. Jetzt bauen wir auch die letzte Meile der Qualität und stellen sicher, dass KI-generierte Inhalte präzise, kontextbezogen und vertrauenswürdig sind, bevor sie jemanden erreichen.

Das leistet der AI Quality Layer. Er ist kein Experiment. Er ist bereit für den Einsatz. Für alle Mitarbeitenden.

Wir zeigen dir gerne, wie der AI Quality Layer in Staffbase funktioniert.